AI의 진짜 도전은 모델이 아니라 인프라에 있다

AI 이야기를 하면 항상 모델 크기와 파라미터 수, GPU 성능이 주목받습니다. 그러나 현장에서 AI를 실제로 운영해본 사람들은 더 큰 문제가 다른 곳에 있음을 잘 압니다. 모델은 준비됐는데 돌아가지 않거나, GPU는 있는데 제대로 묶이지 않거나, 전기와 냉각 문제로 확장이 멈추는 경우가 많죠. AI의 한계를 모델 자체에서 찾기보다, AI를 제대로 돌릴 수 있는 인프라와 운영 구조가 더 큰 병목이라는 인식이 점차 확산되고 있습니다. 최근에는 AI 모델의 우수성보다 ‘AI를 처음부터 끝까지 실제로 운영할 수 있느냐’가 더 중요한 화두로 부상했으며, 엔드투엔드 AI 클라우드 인프라의 중요성이 크게 부각되고 있습니다.

AI 인프라의 물리적 한계: 전력, 냉각, 네트워크의 삼각축

AI 연산은 결국 전기를 소비하고 열을 발생시키며, 그 열을 효율적으로 제거해야 지속적인 연산이 가능합니다. AI 인프라의 병목은 항상 전력, 냉각, 네트워크라는 세 축으로 수렴합니다. 특히 냉각 분야에서 혁신이 필요한데, 일반 데이터 센터의 PUE(전력사용효율)가 1.4 이상인 반면, 다이렉트 리퀴드 쿨링(DLC) 기술을 적용하면 1.1 수준까지 낮출 수 있습니다. 이는 단순한 효율 개선이 아니라 고밀도 GPU 환경을 물리적으로 가능하게 만드는 기술입니다. 실제로 NVIDIA H100 GPU에서 DLC 방식을 사용하면 공냉식 대비 피크 성능이 17% 더 나오면서 전력은 16% 적게 소모한다는 연구 결과도 있습니다.

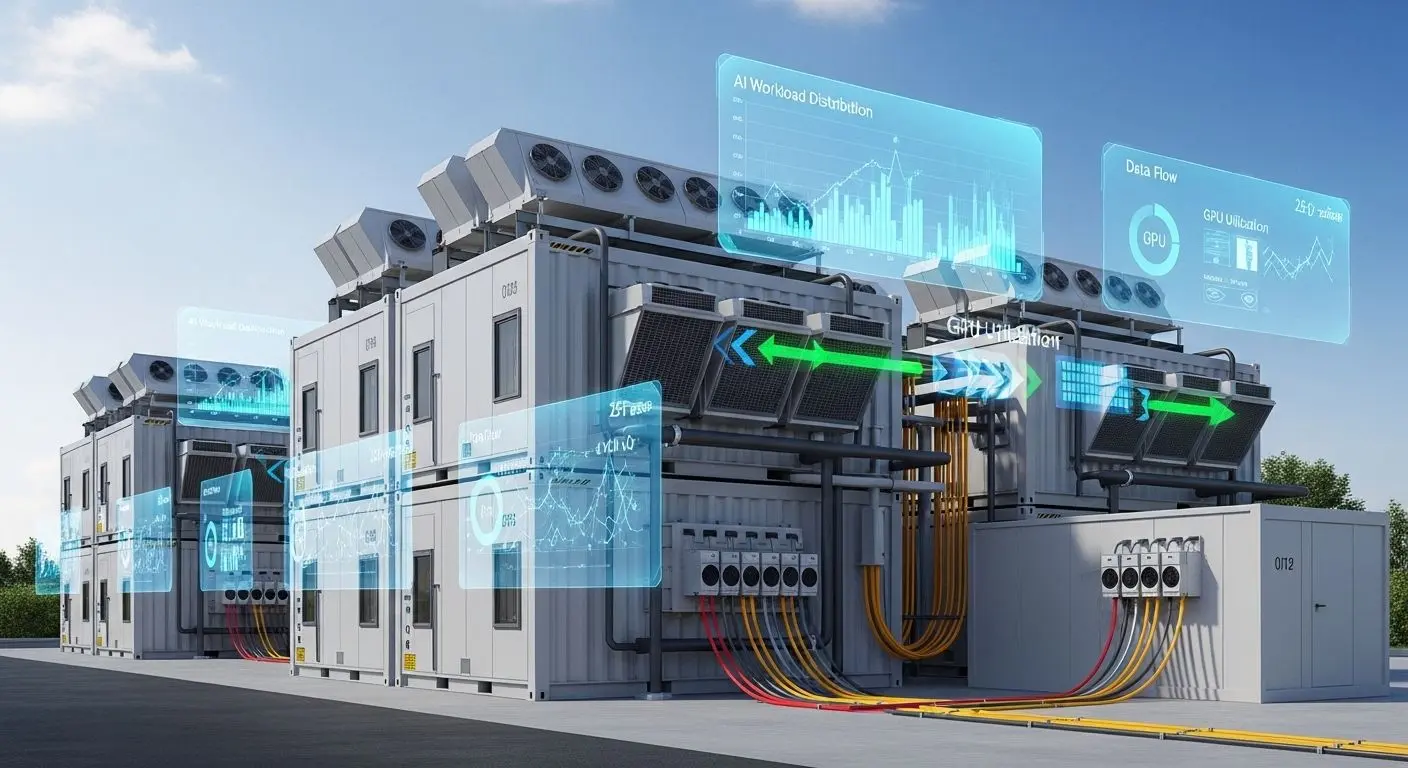

엘리스 클라우드의 AI PMDC: 모듈형 데이터 센터의 패러다임 전환

엘리스 클라우드는 AI PMDC(Portable Modular Data Center)를 도입하며 AI 인프라의 새로운 표준을 제시하고 있습니다. AI PMDC는 데이터 센터를 하나의 거대한 건물로 보지 않고, AI 연산에 필요한 전력, 냉각, 네트워크를 갖춘 모듈 단위로 접근합니다. 이 모듈 구조는 기존 건물 공사 방식보다 훨씬 빠른 구축(3개월 내)이 가능할 뿐만 아니라, AI 환경의 변동성을 효과적으로 감당할 수 있습니다. GPU 세대가 빠르게 변화하고 필요한 연산 규모가 계속 달라지는 환경에서, 모듈을 추가하거나 재배치하며 유연하게 확장할 수 있는 구조입니다. 특히 고밀도 랙 구축은 단순히 장비를 많이 넣는 것이 아니라 전력 공급/분배, 냉각 루프 구성, 네트워크 패브릭 설계까지 포함하는 종합적 접근이 필요합니다.

ECI: AI 전용 가상화 기술로 GPU 활용률 100% 달성

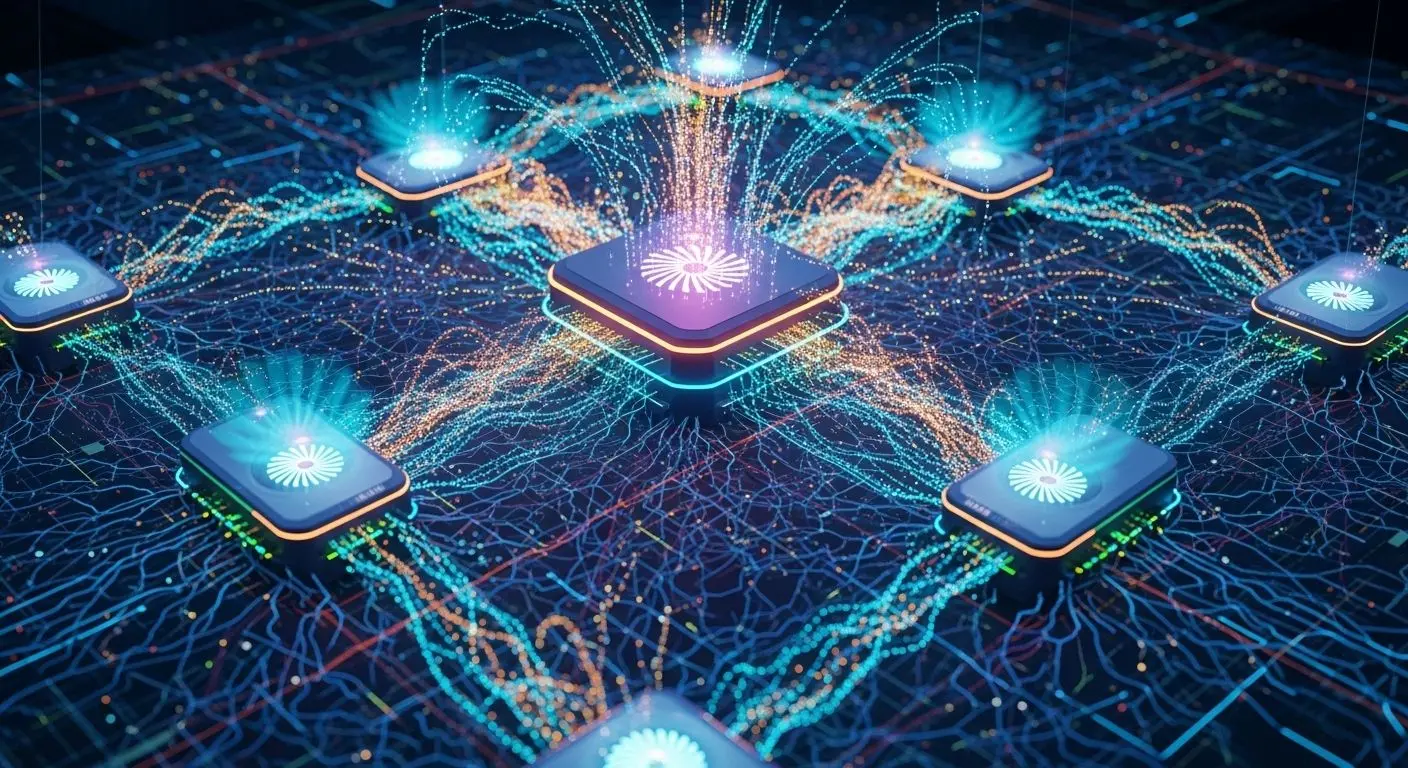

엘리스 클라우드 인프라스트럭처(ECI)는 단순한 클라우드 관리 도구를 넘어 AI 연산에 특화된 가상화 기술입니다. 기존 대규모 서버 환경에서는 관리자가 수작업으로 자원을 할당해야 해 GPU 활용률이 30% 수준에 머물렀지만, ECI는 복잡한 자원 관리 과정을 자동화해 국가 사업 실증 기준으로 100%에 가까운 GPU 활용률을 기록했습니다. ECI는 AI 연산에 직접 관여하는 GPU와 네트워크, 스토리지 전반에 정밀하게 설계·검증되어 가상화 미적용 환경 대비 성능 하락을 1% 미만으로 유지합니다. 이는 단순한 VM 관리가 아니라 AI 작업 단위로 자원을 배치하고 해소하면서 성능과 비용을 함께 관리하는 혁신적 접근법입니다.

네트워크: AI 연산의 일부가 된 핵심 인프라

AI 인프라에서 네트워크는 더 이상 단순한 연결 수단이 아닙니다. 대규모 AI 학습에서는 데이터 병렬, 모델 병렬 또는 이 둘을 혼합한 구조로 이루어지는데, 이때 GPU들은 매 스텝마다 계산 결과를 서로 교환하거나 동기화해야 합니다. 모델 병렬 환경에서는 한 GPU에서 계산한 중간 결과를 다음 GPU로 넘기지 못하면 다음 연산 자체가 진행되지 않습니다. 따라서 네트워크 지연이 곧 연산 지연으로 이어지죠. AI 네트워크에서는 단순한 대역폭 숫자보다 지연 시간, 확장성, 토폴로지가 훨씬 중요해집니다. GPU 수가 늘어날수록 네트워크가 성능을 제약하는 병목이 되기 쉽고, 네트워크 설계가 잘못되면 GPU를 더 추가해도 성능이 거의 향상되지 않는 상황이 발생합니다.

실제 적용 사례와 산업별 활용: LG AI 연구원부터 싱가포르 국방부까지

엘리스 클라우드의 기술력은 다양한 실제 적용 사례에서 입증되고 있습니다. LG AI 연구원의 B200 1228장 클러스터링 환경을 제공해 X41원 같은 모델의 추론 성능과 안정성을 검증한 사례가 대표적입니다. 이처럼 대규모 GPU를 실제로 묶어 검증·운영까지 간 흐름은 네트워크와 운영의 중요성을 보여주는 살아있는 증거입니다. 엘리스 클라우드는 교육뿐 아니라 로보틱스, 의료, 국방, 금융 등 다양한 산업에서 활용되고 있으며, 최근에는 싱가포르 국방보안 벤처 기업 캡비스타가 엘리스 클라우드의 AI 특화 클라우드를 높이 평가해 파트너십을 체결하기도 했습니다. 데이터 센터 구축부터 클라우드 운영까지 묶어 접근하고, AI PMDC와 ECI를 결합해 AI 워크로드 전 과정을 지원하는 형태로 확장해오면서 아시아 최초 수냉식 NVIDIA B200 클러스터를 실제 운용 가능한 인프라까지 구축한 것이 이런 기술력과 경쟁력의 결과입니다.