✨ 터보 컨트: AI 메모리 효율화의 시작

구글의 터보 컨트 기술 등장은 AI 메모리 시장에 큰 파장을 일으켰습니다. 많은 이들이 메모리 수요 감소를 예상했지만, 사실 그 본질은 KV 캐시 압축에 있습니다. 이는 AI 모델이 추론 과정에서 사용하는 임시 저장 공간을 효율적으로 관리하여 기존보다 훨씬 적은 메모리로 더 많은 정보를 처리할 수 있게 합니다. 💡 특히 HBM 기준 최대 8배까지 빨라진다는 주장은 업계에 충격을 주었죠.

🔍 제본스의 역설: 효율이 반드시 절감으로 이어지지 않는 이유

역사적으로 기술 효율성이 높아질 때마다 사용량은 오히려 폭발적으로 증가하는 ‘제본스의 역설’이 반복되어 왔습니다. 자동차 연비가 좋아진다고 기름 사용량이 줄지 않듯이, 터보 컨트가 AI 메모리 사용량을 줄여도 전체 AI 시장의 메모리 수요는 줄어들지 않을 가능성이 큽니다. 📈 AI 기술은 아직 초기 단계이며, 비용 효율이 높아지면 더 많은 응용 분야와 사용자가 생겨날 것이기 때문이죠.

💡 2026년 전문가 시선: 터보 컨트와 AI 에이전트 시대

업계 전문가들은 터보 컨트가 메모리 절감보다는 AI의 활용 범위를 넓히는 데 기여할 것으로 전망합니다. 동일한 메모리로 더 긴 문맥, 더 많은 세션, 그리고 복잡한 에이전트 작업을 가능하게 하여 AI 시장의 전체 파이를 키울 것이라는 분석이죠. 💰 SK 하이닉스의 대규모 ASML 장비 주문처럼, 주요 메모리 제조사들은 2026년에도 AI 메모리 수요 증가에 대비해 투자를 확대하고 있습니다. 이는 터보 컨트가 HBM 수요를 없애기보다 메모리 계층을 더욱 두껍게 만들 것이라는 증거입니다.

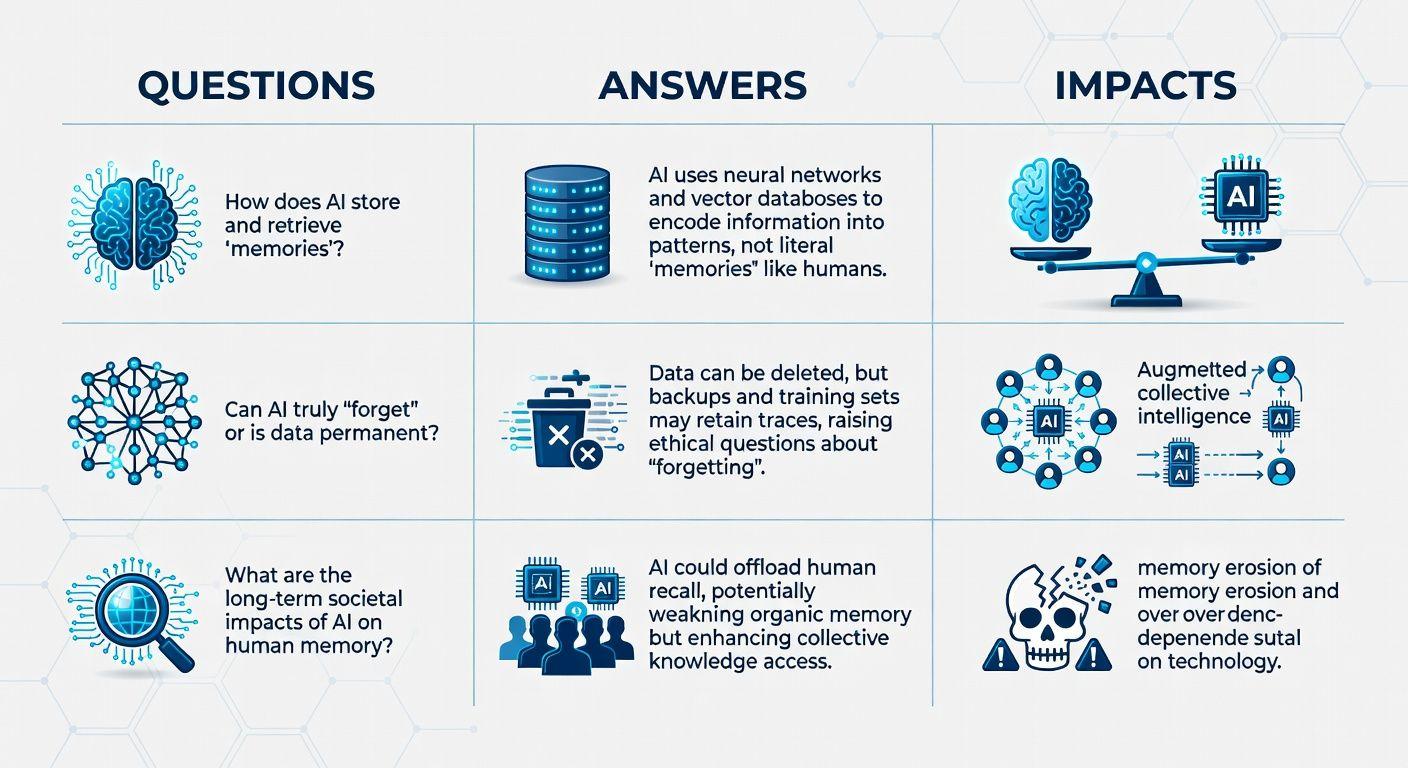

✅ 핵심 요약 Q&A

Q: 터보 컨트가 메모리 수요를 줄이나요? A: 단기적으로는 효율을 높이지만, ‘제본스의 역설’처럼 장기적으로는 전체 AI 시장의 수요 확대로 이어져 메모리 수요는 오히려 늘어날 가능성이 큽니다. Q: 터보 컨트의 핵심 기술은 무엇인가요? A: AI 추론 중 사용되는 KV 캐시를 효율적으로 압축하여, 동일 메모리로 더 긴 문맥과 복잡한 작업을 가능하게 하는 것입니다. Q: 2026년 AI 메모리 시장 전망은 어떤가요? A: 터보 컨트와 같은 효율화 기술 덕분에 AI 응용 분야가 넓어지면서 HBM 등 고성능 메모리 수요는 지속적으로 증가할 것으로 예상됩니다. Q: 터보 컨트가 가져올 변화는 무엇인가요? A: 비용 효율이 높아져 AI가 더 많은 기업과 개인에게 확장되고, 이는 곧 AI 시장의 전반적인 경쟁 심화와 성장을 촉진할 것입니다.