AI 반도체 전쟁의 새로운 국면: 엔비디아 vs 구글

여러분, 반갑습니다! AI 기술 블로ger 에러입니다. AI 반도체 시장의 절대 강자 엔비디아와 그 뒤를 쫓는 구글의 경쟁이 갈수록 흥미로워지고 있습니다. 특히 구글이 자체 개발한 AI 칩 ‘TPU’의 영향력을 넓혀가면서, 엔비디아의 독주 체제에 균열이 생길 수 있다는 전망이 나오기도 했는데요. 이런 상황에서 엔비디아가 예상치 못한 ‘히든카드’를 꺼내 들었습니다. 바로 ‘루빈 CPX(Rubin CPX)’라는 새로운 칩입니다. 놀랍게도 이 칩에는 그동안 엔비디아의 상징과도 같았던 고성능 HBM 메모리가 아닌, 게이밍 그래픽카드에 주로 쓰이는 GDDR 메모리가 탑재되었습니다. 오늘은 이 루빈 CPX가 어떻게 구글 TPU에 대항하는 엔비디아의 강력한 무기가 될 수 있는지, 그 전략을 쉽고 친절하게 파헤쳐 보겠습니다.

AI의 두뇌 활동: ‘프리필’과 ‘디코드’의 차이

엔비디아의 전략을 이해하려면, 먼저 AI가 우리의 질문에 답하는 과정을 살펴봐야 합니다. 이 과정은 크게 두 단계로 나뉩니다. 첫 번째는 ‘프리필(Prefill)’ 단계입니다. 우리가 PDF 파일이나 긴 질문처럼 대량의 정보를 입력했을 때, AI가 그 내용을 한 번에 읽고 전체적인 맥락을 이해하는 과정이죠. 이 단계는 마치 우리가 두꺼운 책을 처음부터 끝까지 정독하며 핵심을 파악하는 것과 같습니다. 엄청난 계산(컴퓨팅) 능력이 집중적으로 요구되지만, 메모리를 계속 읽고 쓰는 작업은 상대적으로 적습니다. 두 번째는 ‘디코드(Decode)’ 단계입니다. 프리필을 통해 내용을 파악한 AI가 이제 한 단어, 한 단어 답변을 생성해내는 과정입니다. 이때는 이미 이해한 내용(KV 캐시)을 계속해서 메모리에서 꺼내보며 다음 단어를 예측해야 하므로, 메모리와의 데이터 통신이 매우 빈번하게 일어납니다. 즉, 프리필은 ‘계산 집약적’, 디코드는 ‘메모리 집약적’인 작업이라는 핵심적인 차이가 있습니다.

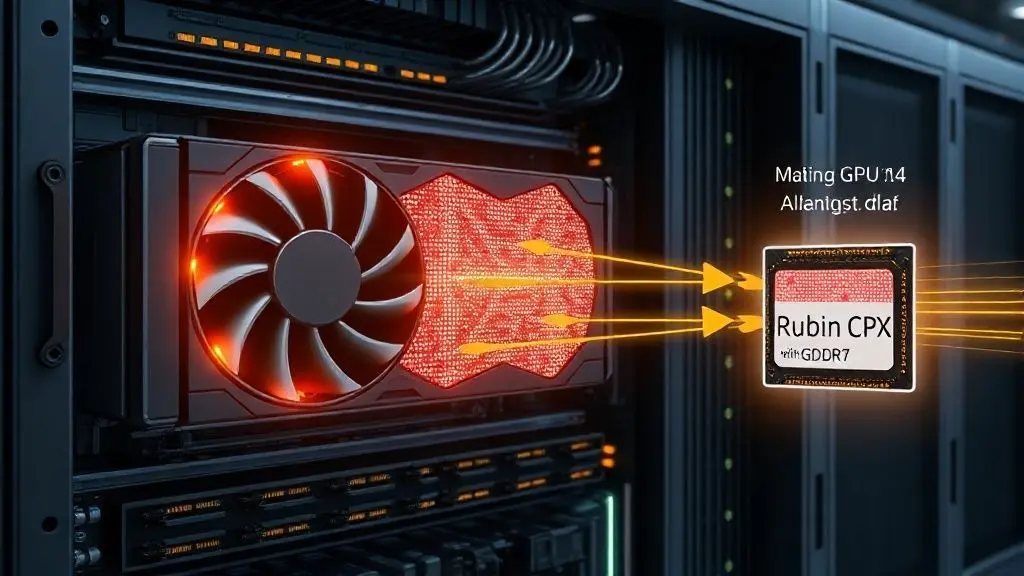

엔비디아의 해법: 작업을 분리하는 ‘루빈 CPX’의 등장

지금까지 엔비디아의 GPU는 HBM이라는 고성능 메모리를 장착하고 이 두 가지 작업을 하나의 칩에서 모두 처리했습니다. 하지만 성격이 다른 두 작업을 한 곳에서 처리하다 보니 자원 활용에 비효율이 발생할 수밖에 없었죠. 엔비디아는 바로 이 지점을 파고들었습니다. 계산이 중요한 ‘프리필’ 단계는 굳이 비싼 HBM이 필요 없다고 판단한 것입니다. 그래서 계산에 특화된 가속기를 따로 만들고, 여기에 HBM 대신 가성비 좋은 GDDR 메모리를 탑재했습니다. 이것이 바로 ‘루빈 CPX’의 탄생 배경입니다. 이제 긴 글이나 영상을 이해하는 프리필 작업은 루빈 CPX가 전담하고, 실제 답변을 생성하는 디코드 작업은 기존의 HBM이 탑재된 루빈 GPU가 맡는 효율적인 분업 체계가 완성된 것입니다.

가성비와 효율, 두 마리 토끼를 잡다

루빈 CPX의 가장 큰 장점은 ‘비용 효율성’입니다. GDDR7 메모리는 HBM보다 가격이 훨씬 저렴하며, TSMC의 첨단 패키징(CoWoS) 공정을 거치지 않아도 되기 때문에 생산 병목 현상에서도 자유롭습니다. 이는 제조 원가를 크게 낮추는 효과로 이어집니다. 일부 분석에 따르면 CPX의 제조원가는 HBM 기반 루빈 GPU의 1/4 수준에 불과할 것이라는 예측도 나옵니다. AI 추론 시장이 학습 시장보다 훨씬 더 커질 것으로 예상되는 지금, 더 저렴하고 효율적인 추론 솔루션을 제공하는 것은 구글 TPU의 공세에 맞설 아주 강력한 무기가 됩니다. 비싼 HBM GPU만 고집하는 대신, 특정 작업에 최적화된 저렴한 옵션을 함께 제공함으로써 고객의 부담을 덜어주고 시장 지배력을 공고히 하려는 엔비디아의 영리한 전략인 셈입니다.

미래 AI 시장의 판도를 바꿀 전략적 한 수

결론적으로, 루빈 CPX는 단순히 새로운 칩 하나가 아니라 AI 시장의 판도를 바꾸려는 엔비디아의 거대한 전략을 보여줍니다. ‘하나의 칩이 모든 것을 해결한다’는 기존의 방식에서 벗어나, 각 작업에 최적화된 칩을 조합하여 시스템 전체의 효율을 극대화하는 하이브리드 방식으로 진화하고 있는 것입니다. 이는 추론 시장에서 가격과 효율성을 무기로 점유율을 높여가는 구글 TPU를 직접 겨냥한 ‘맞춤형 대응’이라 할 수 있습니다. 물론 이것이 구글의 TPU가 엔비디아의 ‘쿠다(CUDA)’ 생태계를 완전히 무너뜨린다는 의미는 아닙니다. 하지만 AI 서비스를 제공하는 기업 입장에서 더 저렴하고 효율적인 선택지가 생긴 만큼, 엔비디아의 아성에 도전할 수 있는 가능성이 충분히 열렸다고 볼 수 있습니다. 앞으로 HBM과 GDDR을 함께 활용하는 엔비디아의 새로운 전략이 AI 반도체 시장에 어떤 변화를 가져올지 지켜보는 것은 매우 흥미로운 관전 포인트가 될 것입니다.